Capítulo 32 Correlação

32.1 Coeficiente de correlação de Pearson (\(r\)) (32.1).304,305

\[\begin{equation} \tag{32.1} r = \dfrac{n \sum{x_i y_i} - \sum{x_i} \sum{y_i}}{\sqrt{\left[n \sum{x_i^2} - (\sum{x_i})^2\right]\left[n \sum{y_i^2} - (\sum{y_i})^2\right]}} \end{equation}\]

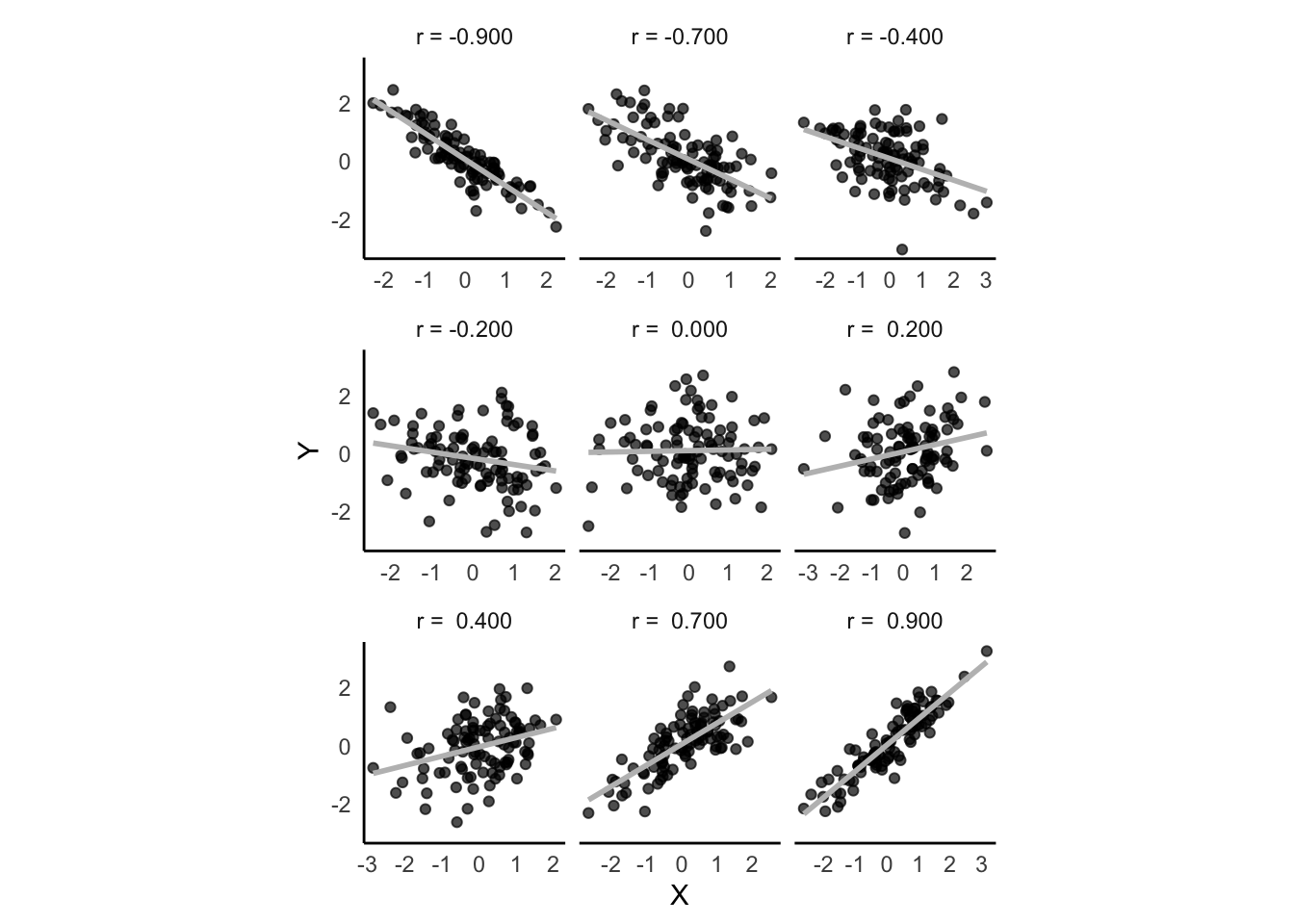

Figura 32.1: Exemplo de diferentes forças e direção de correlação entre duas variáveis X e Y.

O pacote stats156 fornece a função cor.test para calcular o coeficiente de correlação de Pearson (\(r\)).

O pacote correlation306 do projeto easystats307 fornece a função correlation para calcular o coeficiente de correlação de Pearson (\(r\)).

O pacote psychmeta308 fornece a função correct_r_coarseness para calcular o coeficiente de correlação desatenuado (\(r_{x'y'}\)).

O pacote psychmeta308 fornece a função correct_r para calcular o coeficiente de correlação em escala restrita e/ou com erro de mensuração (\(r_{x'y'}\)).

32.2 Coeficiente de correlação ponto-bisserial (\(r_{s}\)) (32.2).304

\[\begin{equation} \tag{32.2} r_{s} = \dfrac{M_{1} - M_{0}}{s_{y}} \sqrt{\dfrac{n_{1}n_{0}}{n^2}} \end{equation}\]

O pacote stats156 fornece a função cor.test para calcular o coeficiente de correlação ponto-bisserial (\(r_{s}\)).

O pacote correlation306 do projeto easystats307 fornece a função correlation para calcular o coeficiente de correlação ponto-bisserial (\(r_{s}\)).

32.3 Coeficiente de correlação de Spearman (\(\rho\)) (32.3).304,305

\[\begin{equation} \tag{32.3} \rho = 1 - \dfrac{6 \Sigma d_{i}^2}{n(n^2 - 1)} \end{equation}\]

O pacote stats156 fornece a função cor.test para calcular o coeficiente de correlação de Spearman (\(\rho\)).

O pacote correlation306 do projeto easystats307 fornece a função correlation para calcular o coeficiente de correlação de Spearman (\(\rho\)).

32.4 Coeficiente de Kendall (\(\tau\)) (32.4).304,305

\[\begin{equation} \tag{32.4} \tau = \dfrac{(n_{c} - n_{d})}{\dfrac{1}{2}n(n-1)} \end{equation}\]

O pacote correlation306 do projeto easystats307 fornece a função correlation para calcular o coeficiente coeficiente Kendall \(\tau\).

32.5 Coeficiente de Cramér (\(V\)) (32.5).REF?

\[\begin{equation} \tag{32.5} V = \sqrt{\dfrac{\chi^2/n}{\min(k-1, r-1)}} \end{equation}\]

32.6 Coeficiente de Sheperd (\(\phi\)) (32.6).REF?

\[\begin{equation} \tag{32.6} \phi = \sqrt{\dfrac{\chi^2}{n}} \end{equation}\]

O pacote correlation306 do projeto easystats307 fornece a função correlation para calcular o coeficiente coeficiente Sheperd \(\phi\).

O pacote corrplot309 fornece a função cor.mtest para calcular os P-valores e intervalos de confiança da matriz de correlação.

32.7 Coeficiente de correlação tetracórica \(r_{tet}\).310,311

O pacote psych312 fornece a função tetrachoric para calcular o coeficiente de correlação tetracórica (\(r_{tet}\)).

32.8 Coeficiente de correlação policórica \(r_{pol}\).311

O pacote psych312 fornece a função tetrachoric para calcular o coeficiente de correlação policórica (\(r_{pol}\)).

32.10 Coeficiente de correlação bisserial \(r_{s}\).311

O pacote psych312 fornece a função tetrachoric para calcular o coeficiente de correlação bisserial (\(r_{s}\)).

Ferreira, Arthur de Sá. Ciência com R: Perguntas e respostas para pesquisadores e analistas de dados. Rio de Janeiro: 1a edição,