Capítulo 16 Distribuições e parâmetros

16.1 Fontes de variabilidade

16.1.1 O que são fontes de variabilidade?

A variabilidade observada nos dados não surge de uma única causa, mas de diferentes processos que atuam simultaneamente durante a geração e a coleta dos dados.191

Compreender de onde vem a variação é essencial para interpretar distribuições, construir modelos e realizar inferência.191

A distribuição dos dados pode ser entendida como uma descrição da variabilidade resultante desses processos.191

16.1.2 Quais são as principais fontes de variabilidade?

Variabilidade real: resulta de diferenças reais entre indivíduos ou unidades observadas.191

Variabilidade de medição: decorre de limitações ou imperfeições nos instrumentos e métodos de medição. Mesmo quando o objeto medido não muda, repetidas medições podem produzir valores ligeiramente diferentes.191

Variabilidade amostral: surge porque diferentes amostras extraídas da mesma população podem produzir resultados distintos.191

Variabilidade experimental ou ambiental: relaciona-se a mudanças nas condições sob as quais os dados são obtidos, como temperatura, tempo, operador ou local de coleta.191

Variabilidade aleatória: refere-se à componente imprevisível associada ao acaso em processos naturais ou experimentais.191

16.1.3 Por que identificar as fontes de variabilidade é importante?

Permite distinguir entre variação real do fenômeno e ruído introduzido pelo processo de medição ou amostragem.191

Ajuda a escolher modelos estatísticos adequados para representar os dados.191

Orienta o desenho de experimentos e estratégias de amostragem para reduzir fontes indesejadas de variação.191

Fundamenta a interpretação das distribuições empíricas e teóricas utilizadas na inferência estatística.191

16.2 Distribuições de probabilidade

16.2.1 O que são distribuições de probabilidade?

A distribuição é o padrão de variação em uma variável ou conjunto de variáveis representado pelos dados.191

Uma distribuição de probabilidade é uma função que descreve os valores possíveis ou o intervalo de valores de uma variável (eixo horizontal) e a probabilidade ou frequência relativa com que os valores ocorrem (eixo vertical).133

16.2.2 Como representar distribuições de probabilidade?

Tabelas de frequência, polígonos de frequência, gráficos de barras, histogramas e boxplots são formas de representar distribuições de probabilidade.192

Tabelas de frequência mostram as categorias de medição e o número de observações em cada uma. É necessário conhecer o intervalo de valores (mínimo e máximo), que é dividido em intervalos arbitrários chamados “intervalos de classe”.192

Se houver muitos intervalos, não haverá redução significativa na quantidade de dados, e pequenas variações serão perceptíveis. Se houver poucos intervalos, a forma da distribuição não poderá ser adequadamente determinada.192

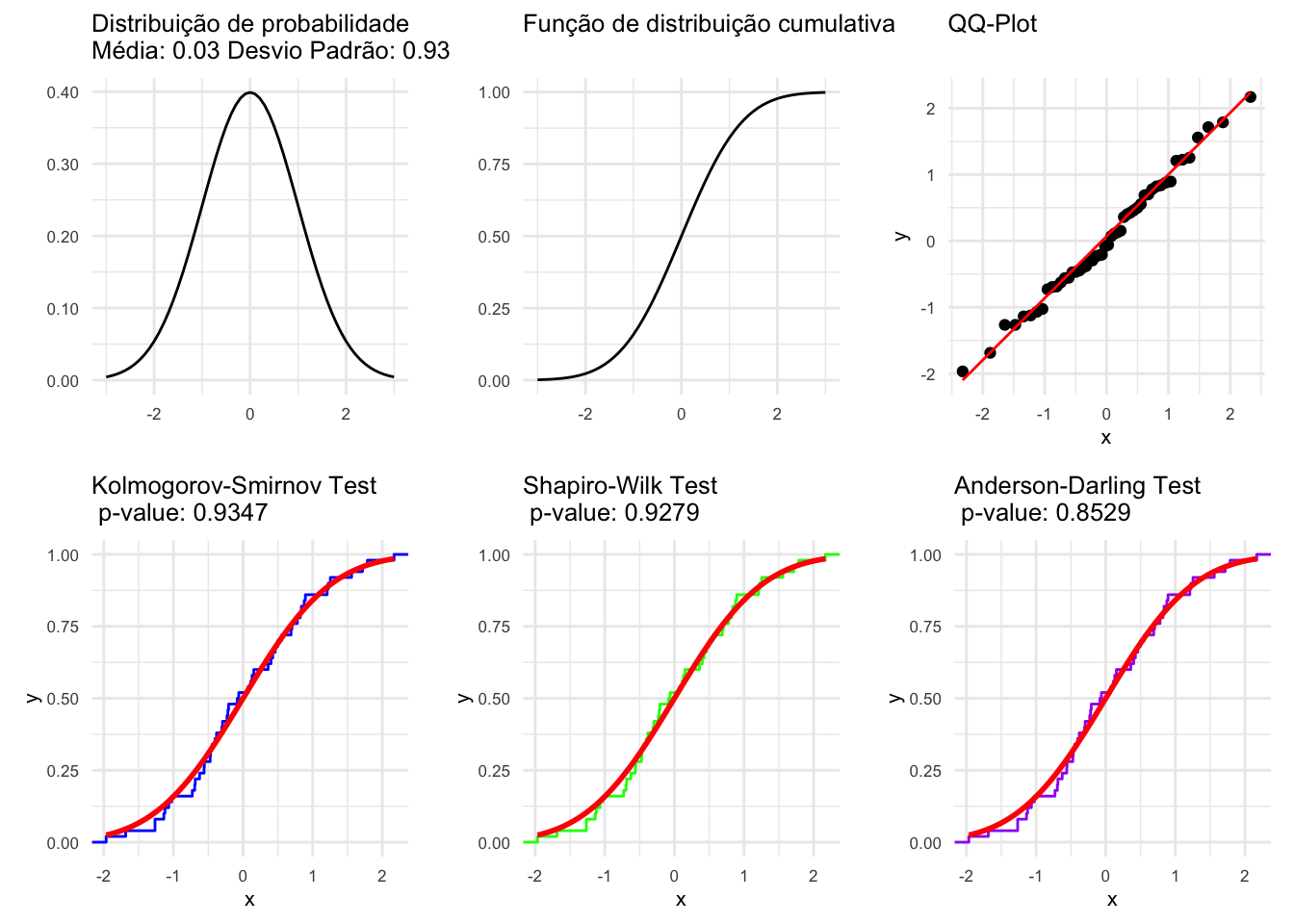

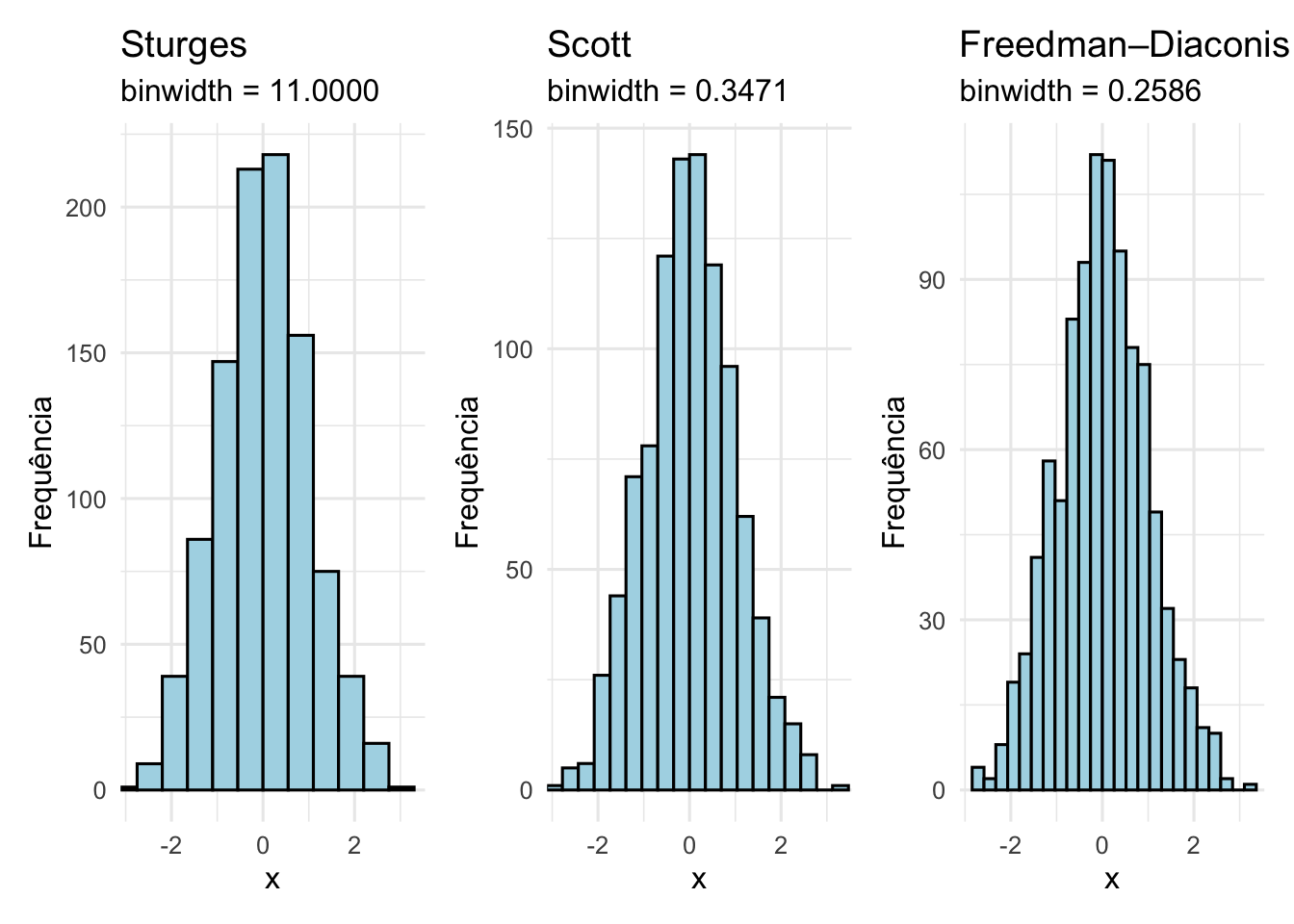

A quantidade de intervalos pode ser determinada pelo método de Sturges, que é dado pela fórmula \(k = 1 + 3.322 \times \log_{10}(n)\), onde \(k\) é o número de intervalos e \(n\) é o número de observações.193

A quantidade de intervalos pode ser determinada pelo método de Scott, que é dado pela fórmula \(h = 3.5 \times \text{sd}(x) \times n^{-1/3}\), onde \(h\) é a largura do intervalo, \(\text{sd}(x)\) é o desvio-padrão e \(n\) é o número de observações.194

A quantidade de intervalos pode ser determinada pelo método de Freedman-Diaconis, que é dado pela fórmula \(h = 2 \times \text{IQR}(x) \times n^{-1/3}\), onde \(h\) é a largura do intervalo, \(\text{IQR}(x)\) é o intervalo interquartil e \(n\) é o número de observações.195

Figura 16.1: Histogramas com diferentes métodos de binning.: Sturges, Scott e Freedman-Diaconis.

A largura das classes pode ser determinada dividindo o intervalo total de observações pelo número de classes. Recomenda-se larguras iguais, mas larguras desiguais podem ser usadas quando existirem grandes lacunas nos dados ou em contextos específicos. Os intervalos devem ser mutuamente exclusivos e não sobrepostos, evitando intervalos abertos (ex.: <5, >10).192

Polígonos de frequência são gráficos de linhas que conectam os pontos médios de cada barra do histograma. Eles são úteis para comparar duas ou mais distribuições de frequência.192

Gráficos de barra verticais ou horizontais representam a distribuição de frequências de uma variável categórica. A altura de cada barra é proporcional à frequência da classe. A largura da barra é igual à largura da classe. A área de cada barra é proporcional à frequência da classe. A área total do gráfico de barras é igual ao número total de observações.192

Histogramas representam a distribuição de frequências de uma variável contínua. A altura de cada barra é proporcional à frequência da classe. A largura da barra é igual à largura da classe. A área de cada barra é proporcional à frequência da classe. A área total do histograma é igual ao número total de observações.192

Boxplots representam a distribuição de frequências de uma variável contínua. A linha central divide os dados em duas partes iguais (mediana ou Q2). A caixa inferior representa o primeiro quartil (Q1) e a caixa superior representa o terceiro quartil (Q3). As linhas geralmente se estendem até 1,5 vezes o intervalo interquartil (IQR). Observações além desse limite são representadas como valores atípicos (representados por pontos individuais).192

O pacote grDevices196 fornece funções da família nclass para determinar a quantidade de classes de um histograma com os métodos de Sturge193, Scott194 ou Freedman-Diaconis195.

O pacote ggplot2197 fornece a função geom_freqpoly para criar polígonos de frequência.

16.2.3 Quais características definem uma distribuição?

- Uma distribuição pode ser definida por modelos matemáticos e caracterizada por parâmetros de tendência central, dispersão, simetria e curtose.REF?

16.3 Tipos de distribuições

16.3.1 O que são distribuições empíricas?

- Distribuições empíricas são obtidas diretamente a partir dos dados observados, sendo geralmente representadas por histogramas, tabelas de frequência ou funções de distribuição empírica.191

16.3.2 O que são distribuições teóricas?

Distribuições teóricas correspondem a modelos matemáticos utilizados para representar o processo gerador dos dados, como as distribuições normal, binomial ou Poisson.191

A comparação entre distribuições empíricas e modelos teóricos é um passo fundamental na modelagem estatística e na inferência.191

16.3.3 O que são distribuições amostrais?

Distribuição amostral descreve a distribuição de uma estatística (como a média ou a proporção) quando calculada em múltiplas amostras da mesma população.191

As distribuições amostrais permitem quantificar a variabilidade associada às estimativas e constituem a base teórica para intervalos de confiança e testes de hipótese.191

16.3.4 Por que todas as distribuições são condicionais?

Uma distribuição descreve a variabilidade de uma variável sob determinadas condições ou suposições.191

Portanto, toda distribuição deve ser entendida como condicional ao processo gerador dos dados, ao modelo adotado ou às informações disponíveis.191

Na inferência estatística, muitas distribuições são condicionais aos parâmetros desconhecidos do modelo, como ocorre na distribuição amostral da média ou na distribuição binomial condicionada à probabilidade de sucesso.191

16.4 Distribuições univariadas

16.4.1 Quais são as distribuições mais comuns?

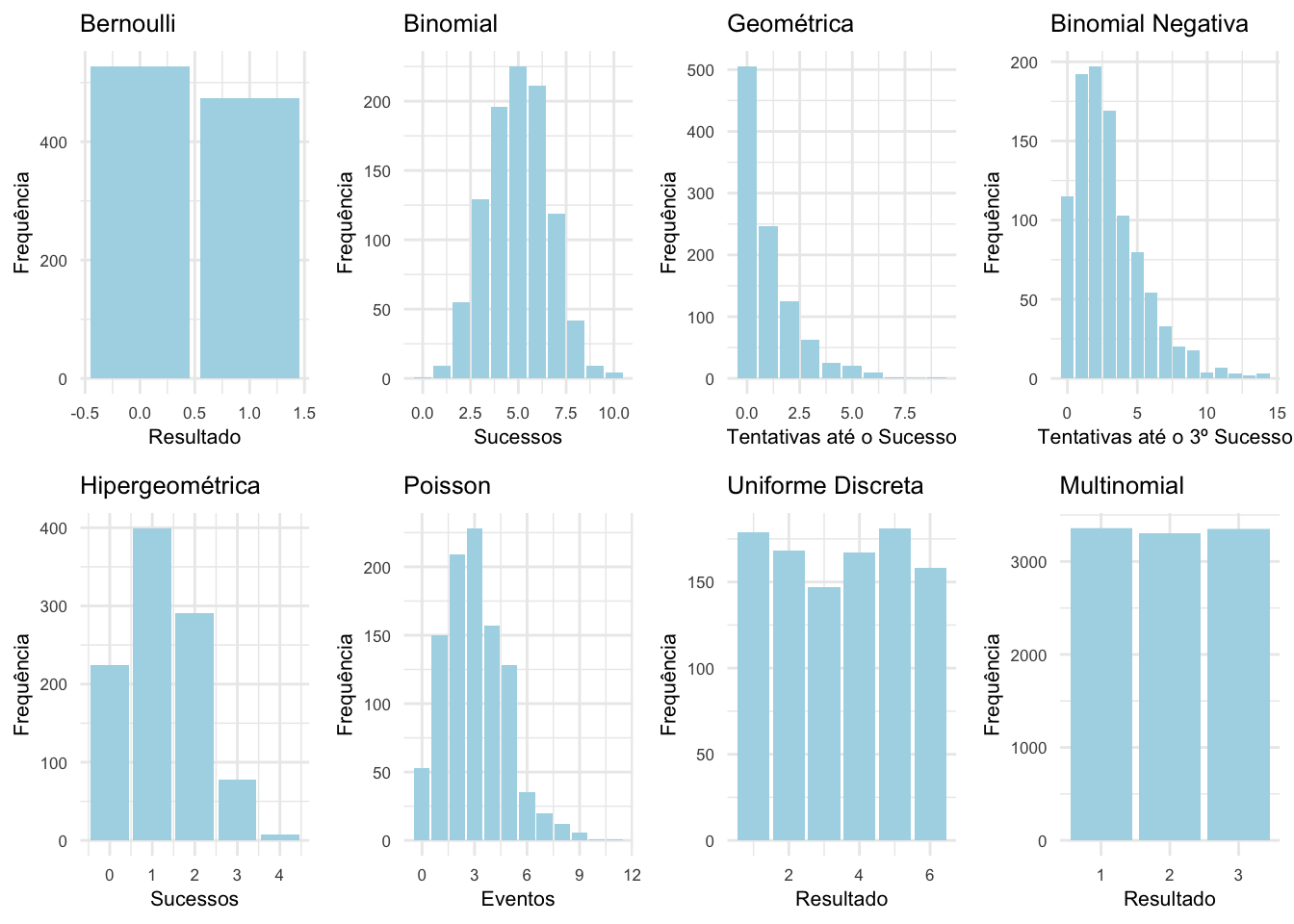

Distribuções discretas:

Bernoulli: resultado de um único teste com dois possíveis desfechos (sucesso ou fracasso).REF?

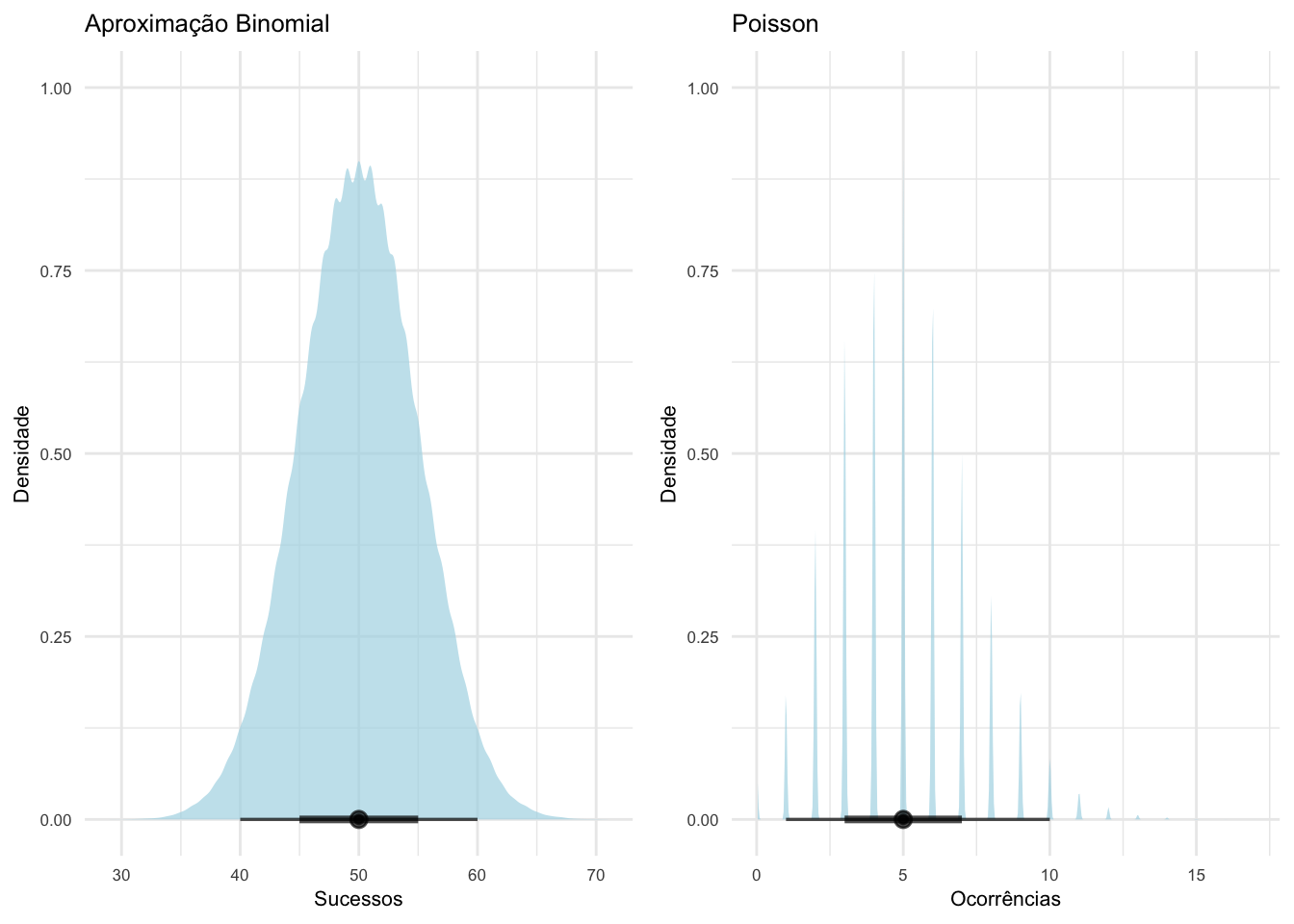

Binomial: número de sucessos em n tentativas independentes.REF?

Geométrica: número de tentativas necessárias até a ocorrência do primeiro sucesso.REF?

Binomial negativa: número de testes até o k-ésimo sucesso.REF?

Hipergeométrica: número de indivíduos na amostra tomados sem reposição.REF?

Poisson: número de eventos em um intervalo de tempo fixo.REF?

Uniforme: resultados (finitos) que são igualmente prováveis.REF?

Multinomial: resultados de múltiplos testes com mais de dois possíveis desfechos.REF?

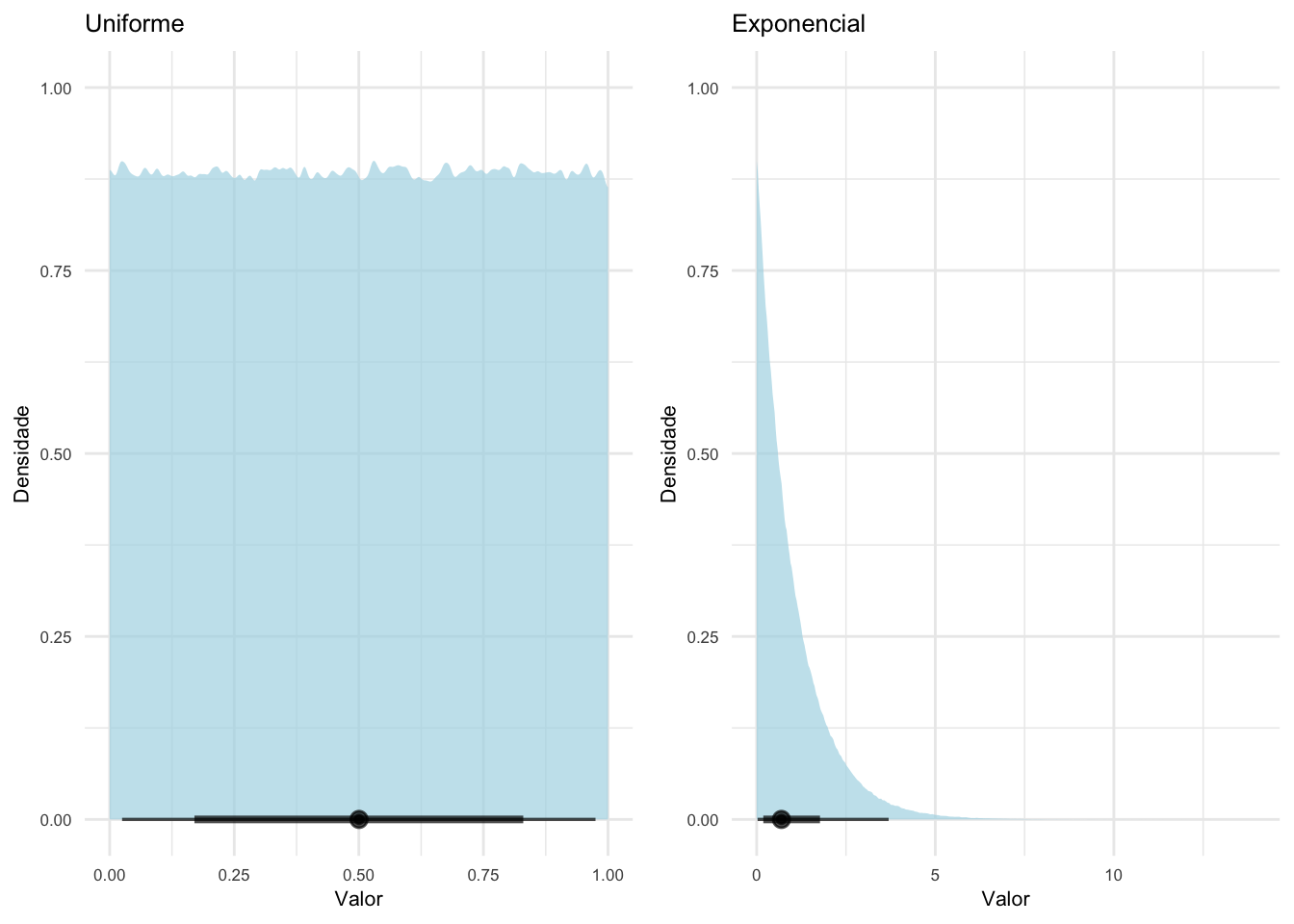

Figura 16.2: Distribuições discretas e suas funções de probabilidade.

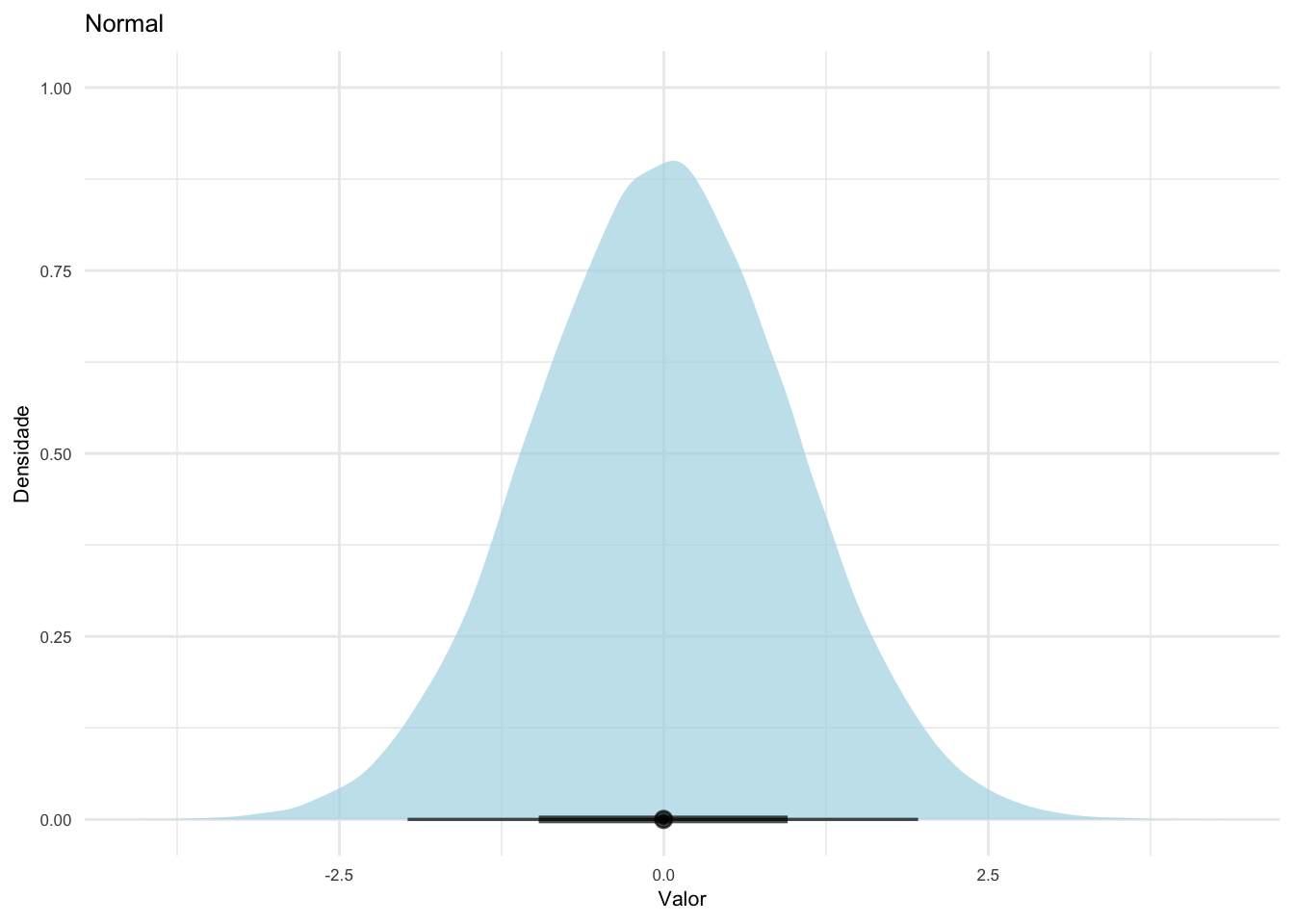

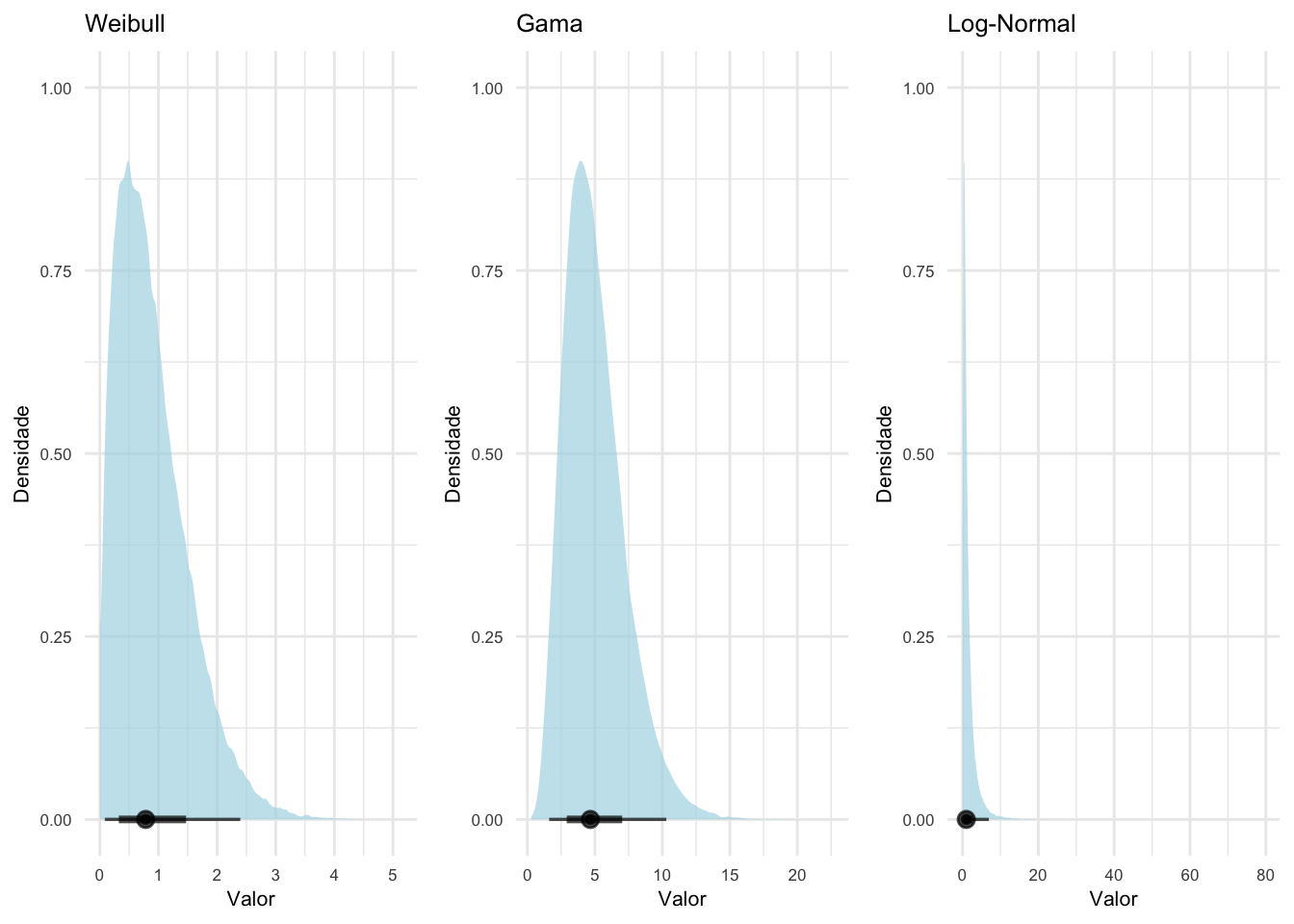

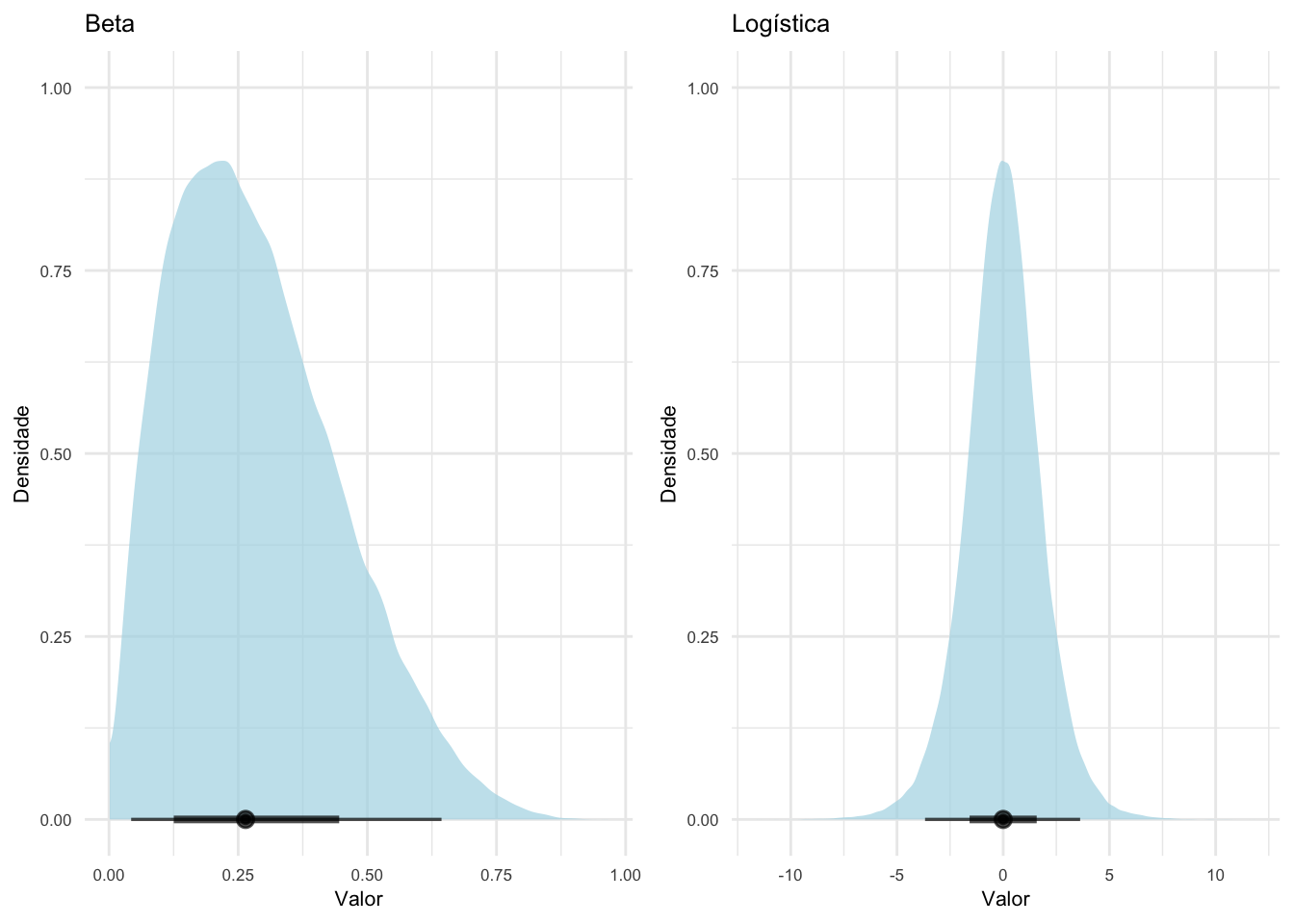

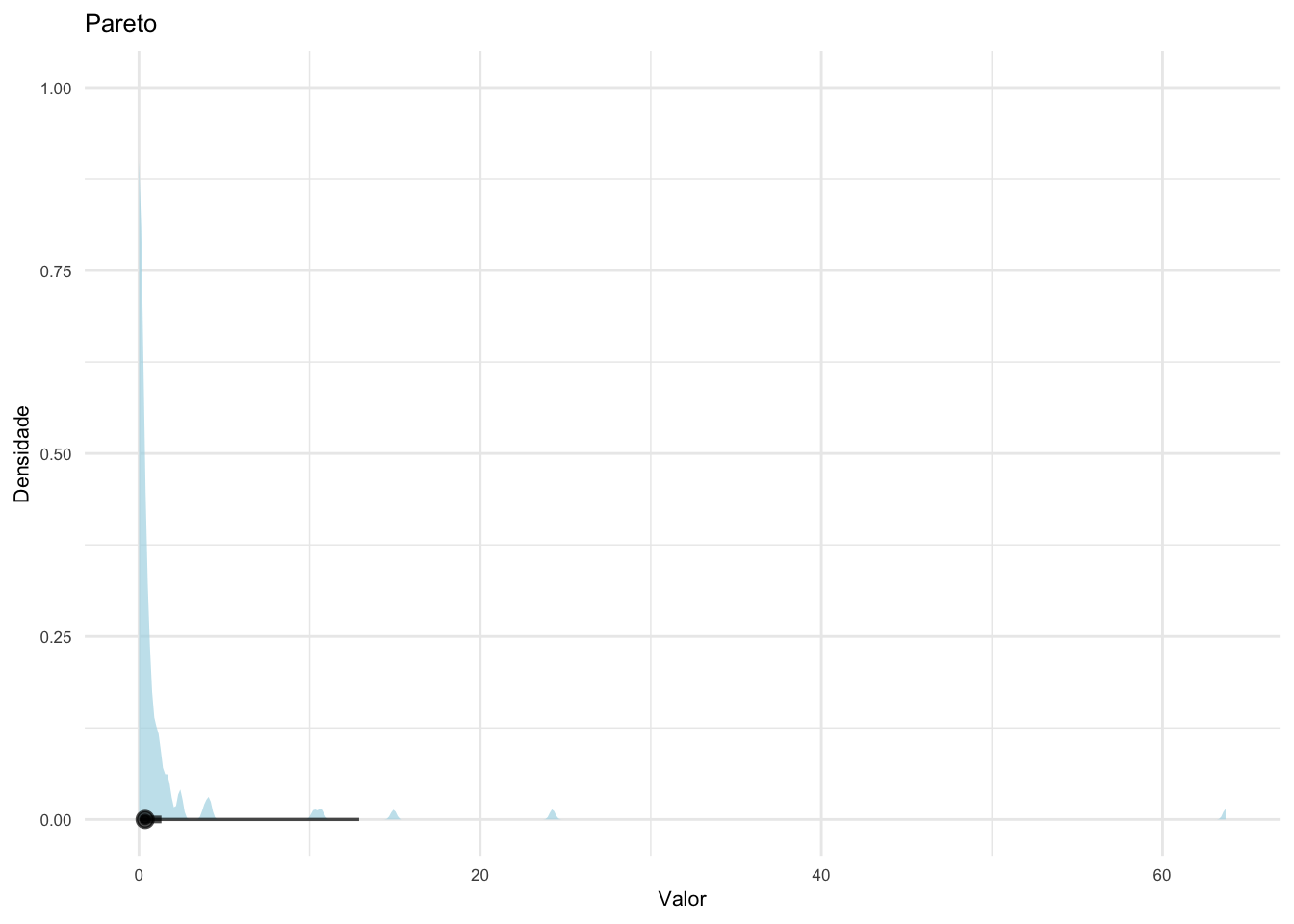

Distribuições contínuas:

Figura 16.3: Distribuições contínuas básicas e suas funções de densidade.

Figura 16.4: Distribuições contínuas aproximadas e suas funções de densidade.

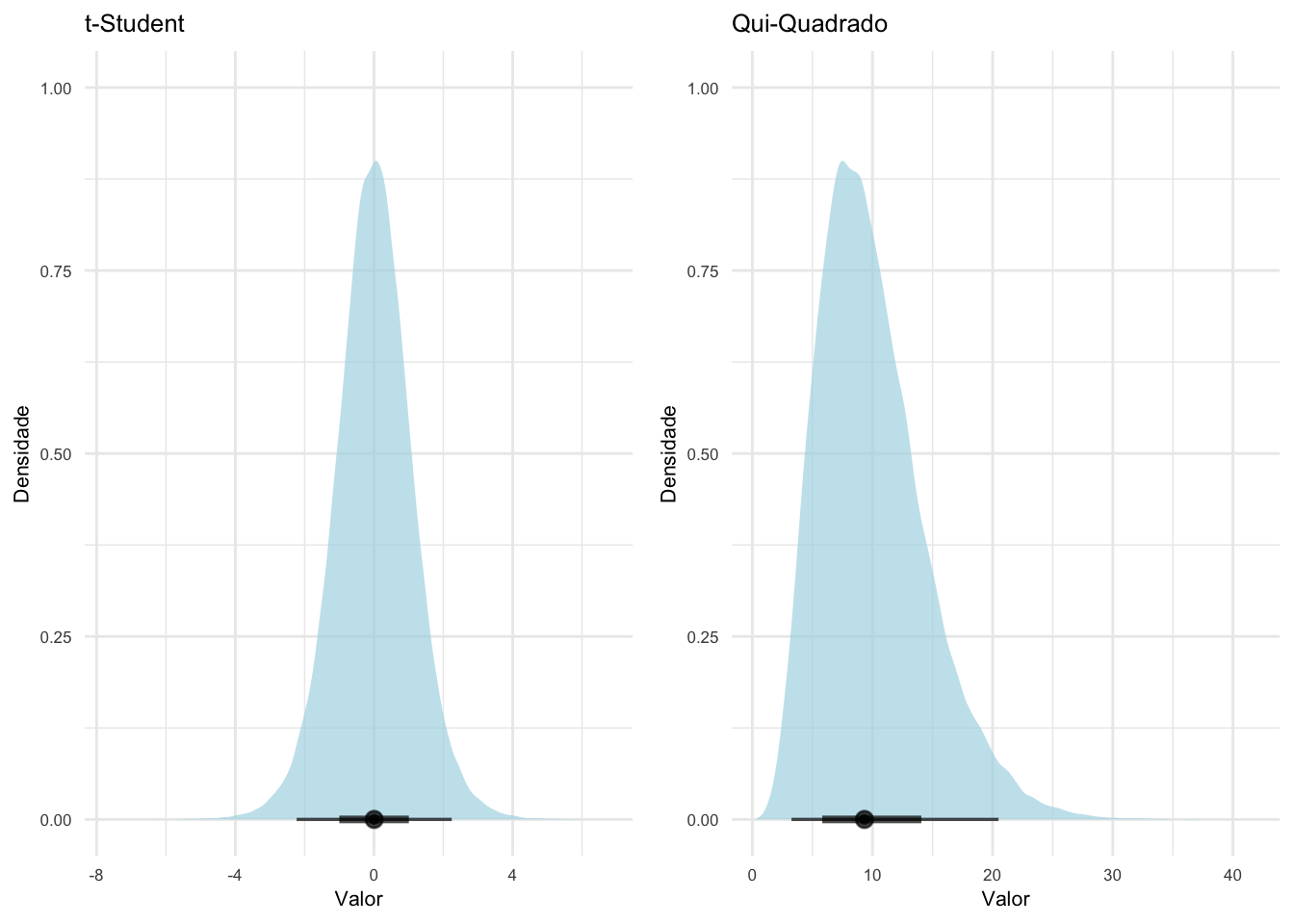

Figura 16.5: Distribuições contínuas aproximadas e suas funções de densidade.

Figura 16.6: Distribuições contínuas para inferência e suas funções de densidade.

Figura 16.7: Distribuições contínuas para dados específicos e suas funções de densidade.

Figura 16.8: Distribuições contínuas para probabilidades e proporções e suas funções de densidade.

Figura 16.9: Distribuições contínuas com caudas pesadas e suas funções de densidade.

16.4.2 Quais são as funções de uma distribuição?

Função de massa de probabilidade (probability mass function, pmf) para variáveis discretas.REF?

Função de densidade de probabilidade (probability density function, pdf) para variáveis contínuas.REF?

Função de distribuição acumulada (cumulative distribution function, cdf).REF?

Função quantílica (quantile function).REF?

Função geradora de números aleatórios.REF?

O pacote stats156 fornece funções de distribuição e funções geradores de números aleatórios para as distribuições normal, Student t, binomial, qui-quadrado, uniforme, dentre outras.

O pacote ggdist198 fornece a função geom_slabinterval para criar gráficos de distribuição de probabilidade (p) e funções de densidade (d) as distribuições.

O pacote ggfortify199 fornece a função ggdistribution para criar gráficos de distribuição de probabilidade (p), funções de densidade (d), funções quantílicas (q) e funções geradores de números aleatórios (r) para as distribuições.

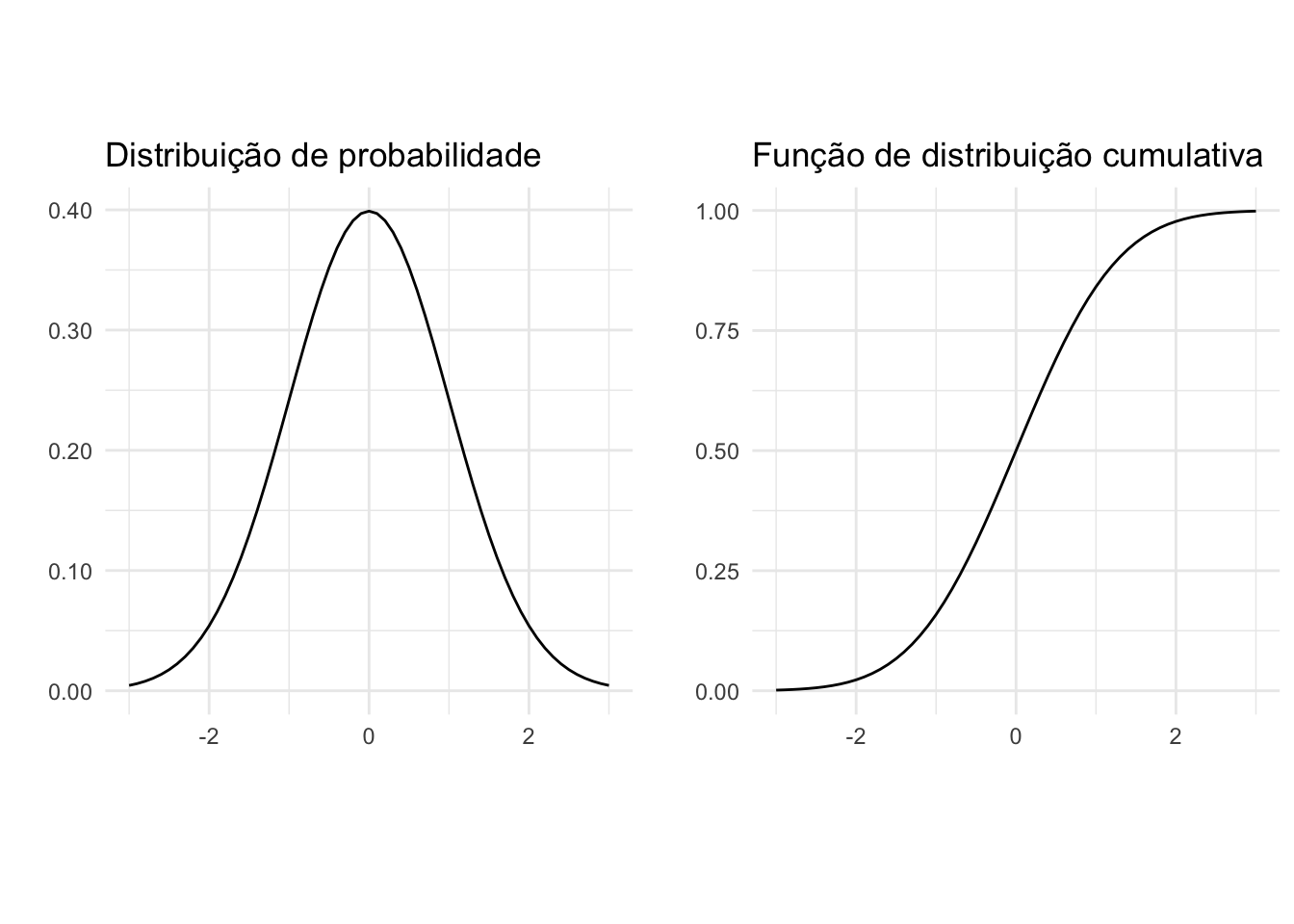

16.4.3 O que é a distribuição normal?

A distribuição normal (ou gaussiana) é uma distribuição com desvios simétricos positivos e negativos em torno de um valor central.134

A relação entre média e desvio-padrão permite interpretar a dispersão dos dados em distribuições aproximadamente normais. A regra empírica estabelece que cerca de 68,2% dos valores situam-se no intervalo \(\bar{x} \pm \sigma\), cerca de 95,4% no intervalo \(\bar{x} \pm 2\sigma\).134,200

O desvio-padrão fornece uma medida direta da variabilidade dos dados em torno da média, permitindo avaliar quão dispersos ou concentrados estão os valores observados em uma amostra.200

Figura 16.10: Distribuições e funções de probabilidade.

16.5 Distribuições multivariadas

16.5.1 O que são distribuições multivariadas?

Distribuições multivariadas descrevem a probabilidade conjunta de duas ou mais variáveis aleatórias.REF?

Exemplos de distribuições multivariadas incluem a distribuição normal multivariada, a distribuição t multivariada, a distribuição binomial multinomial e a distribuição de Dirichlet.REF?

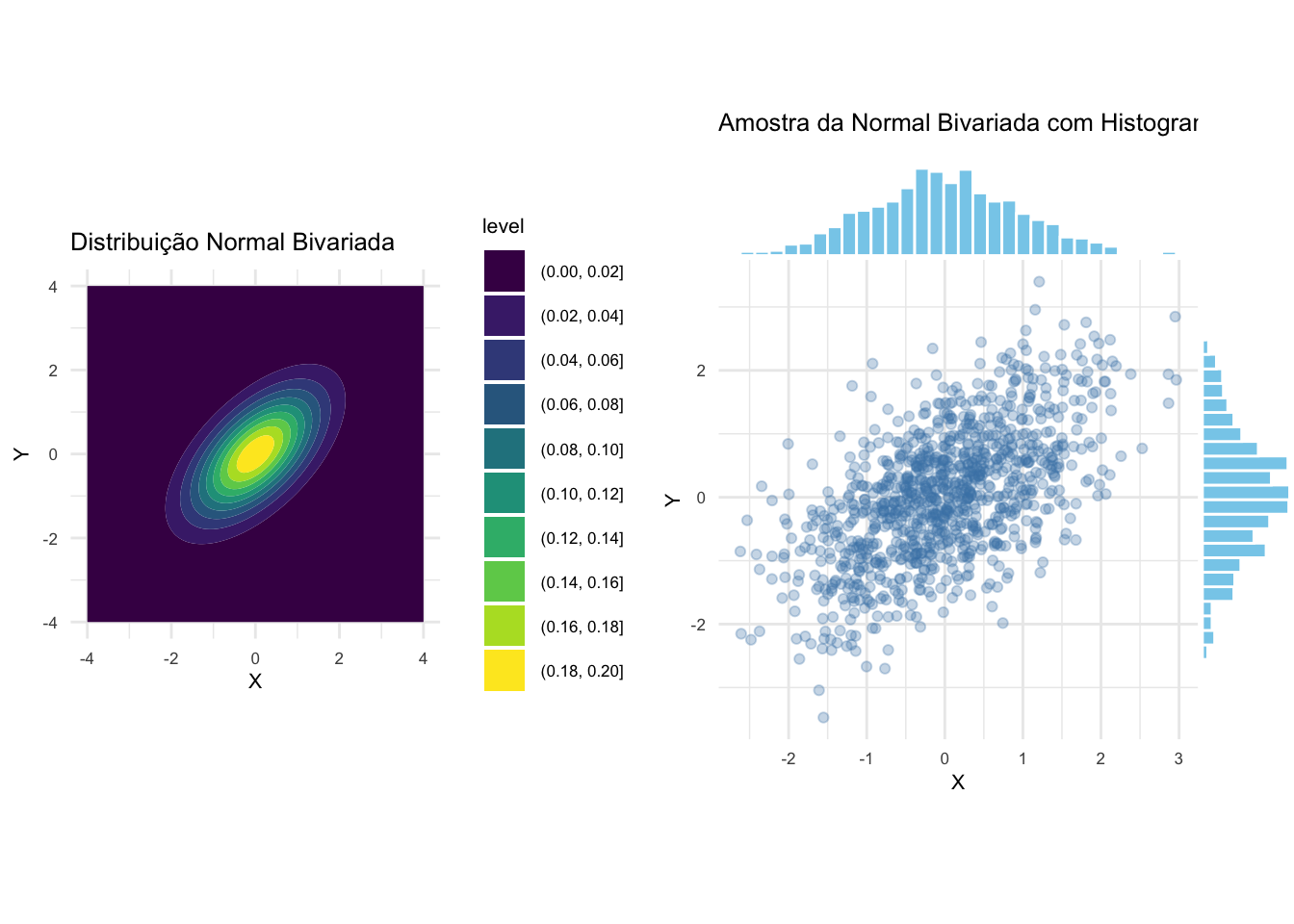

Figura 16.12: Distribuição normal bivariada e amostra simulada com histogramas marginais.

16.6 Parâmetros

16.6.1 O que são parâmetros?

Parâmetros são informações que definem um modelo teórico, como propriedades de uma coleção de indivíduos.132

Parâmetros definem características de uma população inteira, tipicamente não observados por ser inviável ter acesso a todos os indivíduos que constituem tal população.133

16.7 Tendência central

16.7.1 Que parâmetros de tendência central podem ser estimados?

\[\begin{equation} \tag{16.1} \bar{x} = \frac{\sum_{i=1}^{n} x_i}{n} \end{equation}\]

\[\begin{equation} \tag{16.2} \bar{x}_p = \frac{\sum_{i=1}^{n} w_i x_i}{\sum_{i=1}^{n} w_i} \end{equation}\]

\[\begin{equation} \tag{16.3} \bar{x}_g = \left( \prod_{i=1}^{n} x_i \right)^{\frac{1}{n}} \end{equation}\]

\[\begin{equation} \tag{16.4} \bar{x}_h = \frac{n}{\sum_{i=1}^{n} \frac{1}{x_i}} \end{equation}\]

\[\begin{equation} \tag{16.5} \tilde{x} = \begin{cases} x_{\left(\frac{n+1}{2}\right)}, & \text{se } n \text{ é ímpar} \\ \frac{x_{\left(\frac{n}{2}\right)} + x_{\left(\frac{n}{2} + 1\right)}}{2}, & \text{se } n \text{ é par} \end{cases} \end{equation}\]

- Moda (16.6), onde \(f(x)\) é a função de frequência absoluta ou relativa e \(x_1, x_2, \ldots, x_n\) são os valores observados.134,201,205

\[\begin{equation} \tag{16.6} \operatorname{Mo} \in \arg\max_{x \in \{x_1,\ldots,x_n\}} f(x) \end{equation}\]

- Moda (dados agrupados) (16.7), onde: \(L\) = limite inferior da classe modal; \(f_1\) = frequência da classe modal; \(f_0\) = frequência da classe anterior à classe modal; \(f_2\) = frequência da classe posterior à classe modal; \(h\) = amplitude da classe modal.

\[\begin{equation} \tag{16.7} \operatorname{Mo} = L + \frac{(f_1 - f_0)}{(f_1 - f_0) + (f_1 - f_2)} \cdot h \end{equation}\]

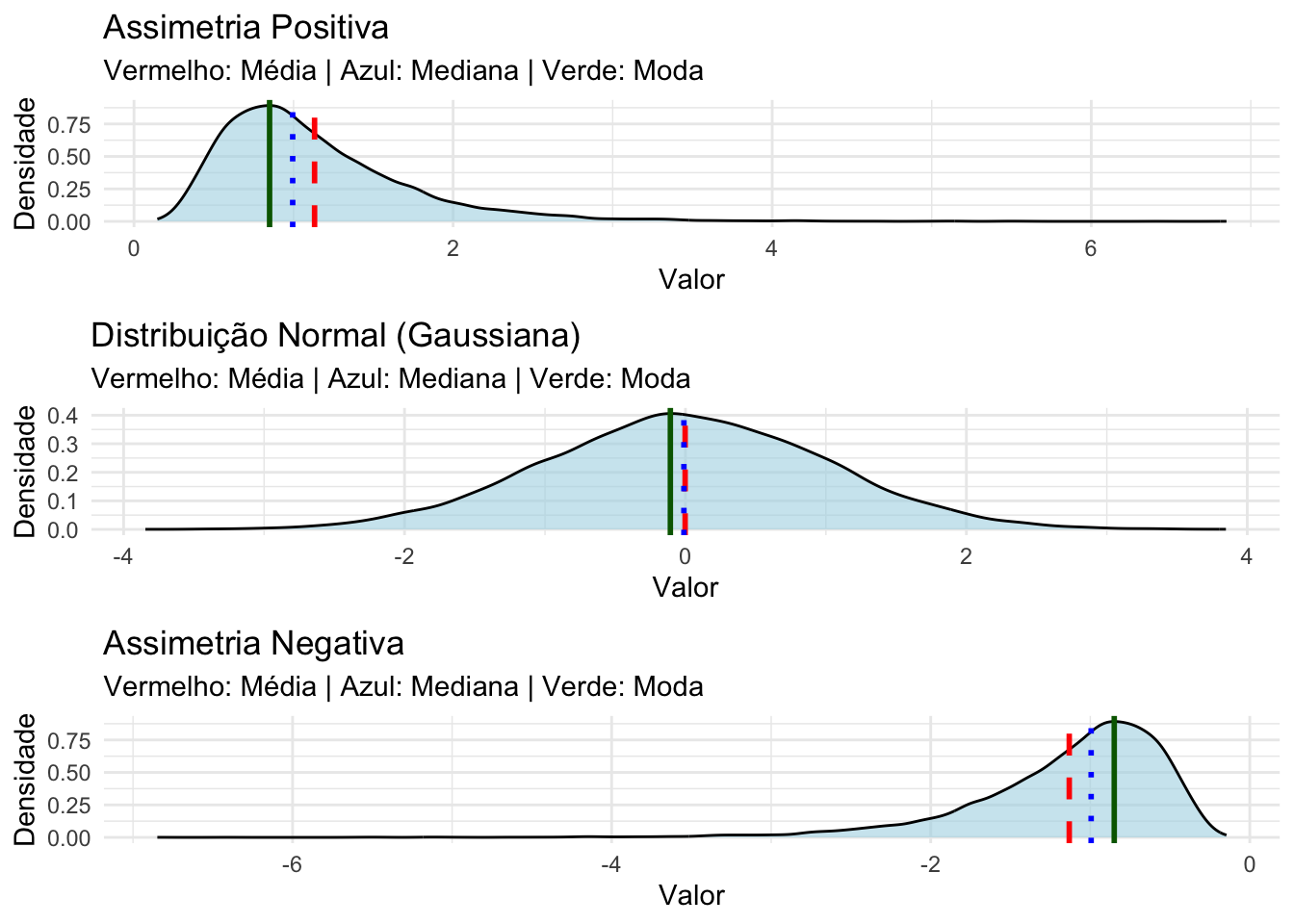

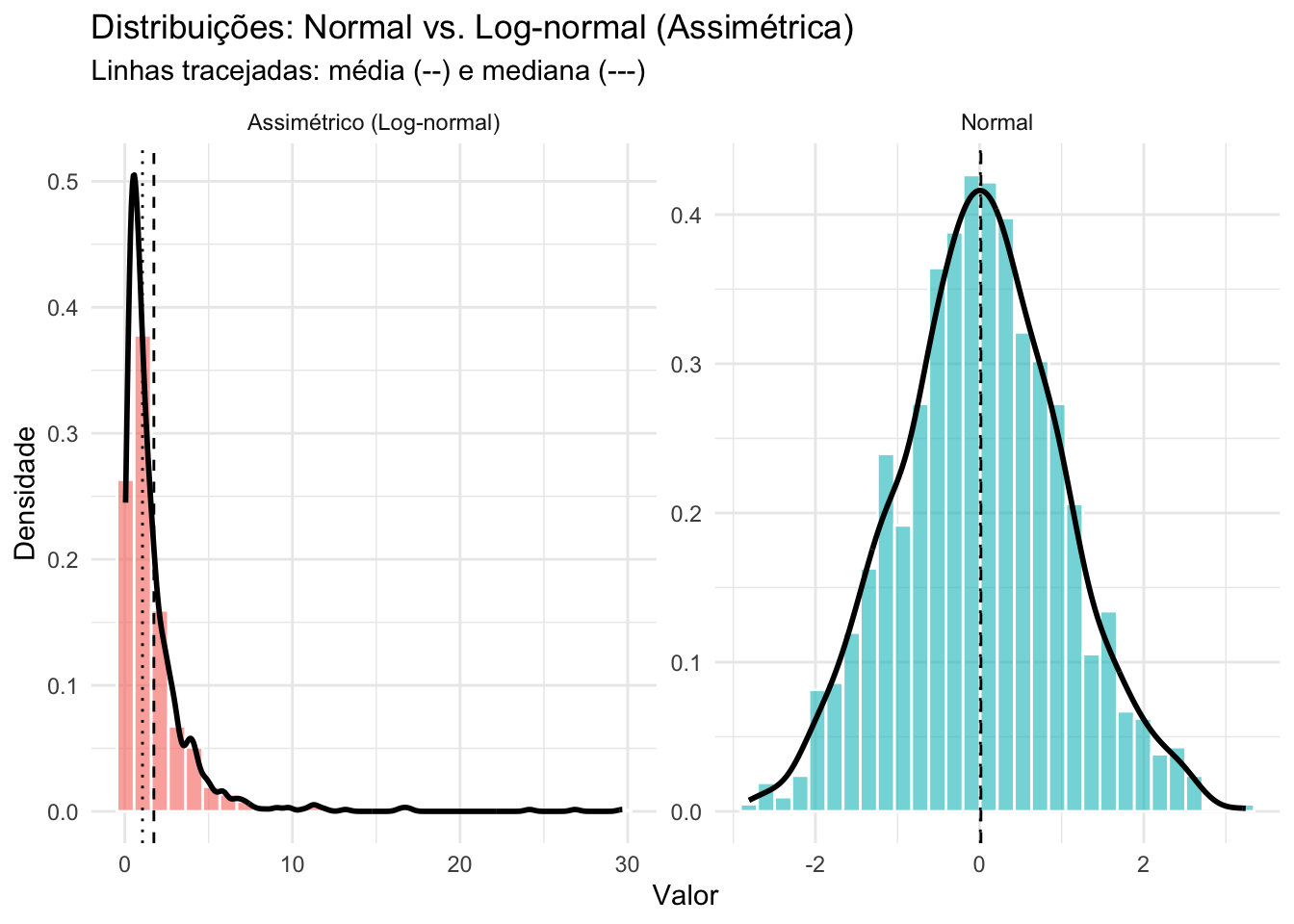

A posição relativa das medidas de tendência central (média, mediana e moda) depende da forma da distribuição.205

Em uma distribuição normal, as três medidas são idênticas.205

A média é sempre puxada para os valores extremos, por isso é deslocada para a cauda em distribuições assimétricas.205

A mediana fica entre a média e a moda em distribuições assimétricas.205

A moda é o valor mais frequente e, portanto, se localiza no pico da distribuição assimétrica.205

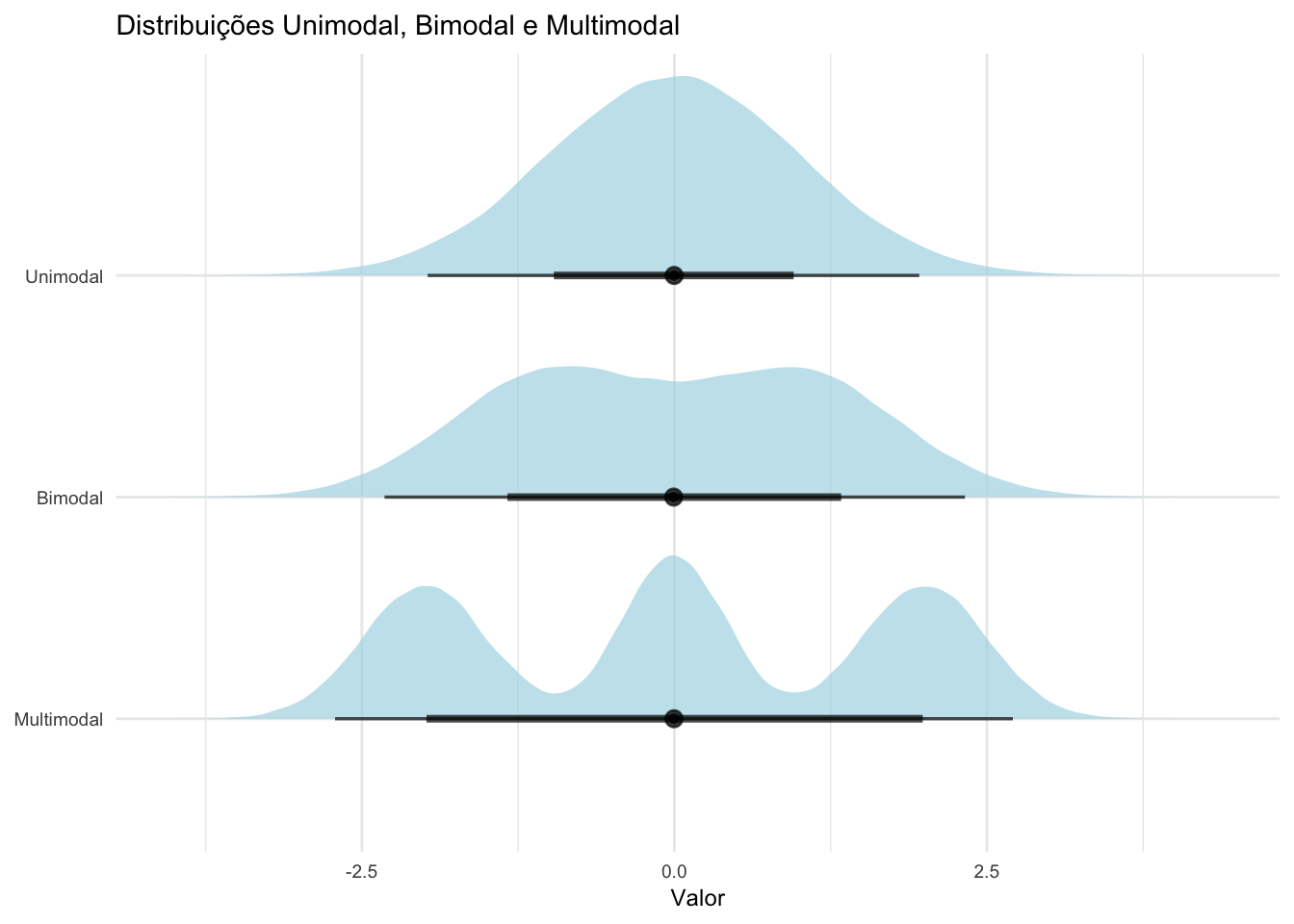

Uma distribuição pode uma moda (unimodal), duas modas (bimodal) ou três ou mais modas (multimodal), indicando a presença de mais de um valor com alta frequência.205

Figura 16.13: Distribuições unimodal, bimodal e multimodal.

Figura 16.14: Parâmetros de tendência central em distribuições assimétricas e normais.

16.7.2 Como escolher o parâmetro de tendência central?

A mediana é preferida à média quando existem poucos valores extremos na distribuição, alguns valores são indeterminados, ou há uma distribuição aberta, ou os dados são medidos em uma escala ordinal.205

A moda é preferida quando os dados são medidos em uma escala nominal.205

A média geométrica é preferida quando os dados são medidos em uma escala logarítmica.205

16.8 Dispersão

16.8.1 Que parâmetros de dispersão podem ser estimados?

\[\begin{equation} \tag{16.8} s^2 = \frac{\sum_{i=1}^{n} (x_i - \bar{x})^2}{n-1} \end{equation}\]

\[\begin{equation} \tag{16.9} s = \sqrt{\frac{\sum_{i=1}^{n} (x_i - \bar{x})^2}{n-1}} \end{equation}\]

\[\begin{equation} \tag{16.10} A = x_{\max} - x_{\min} \end{equation}\]

\[\begin{equation} \tag{16.11} IQR = Q_3 - Q_1 \end{equation}\]

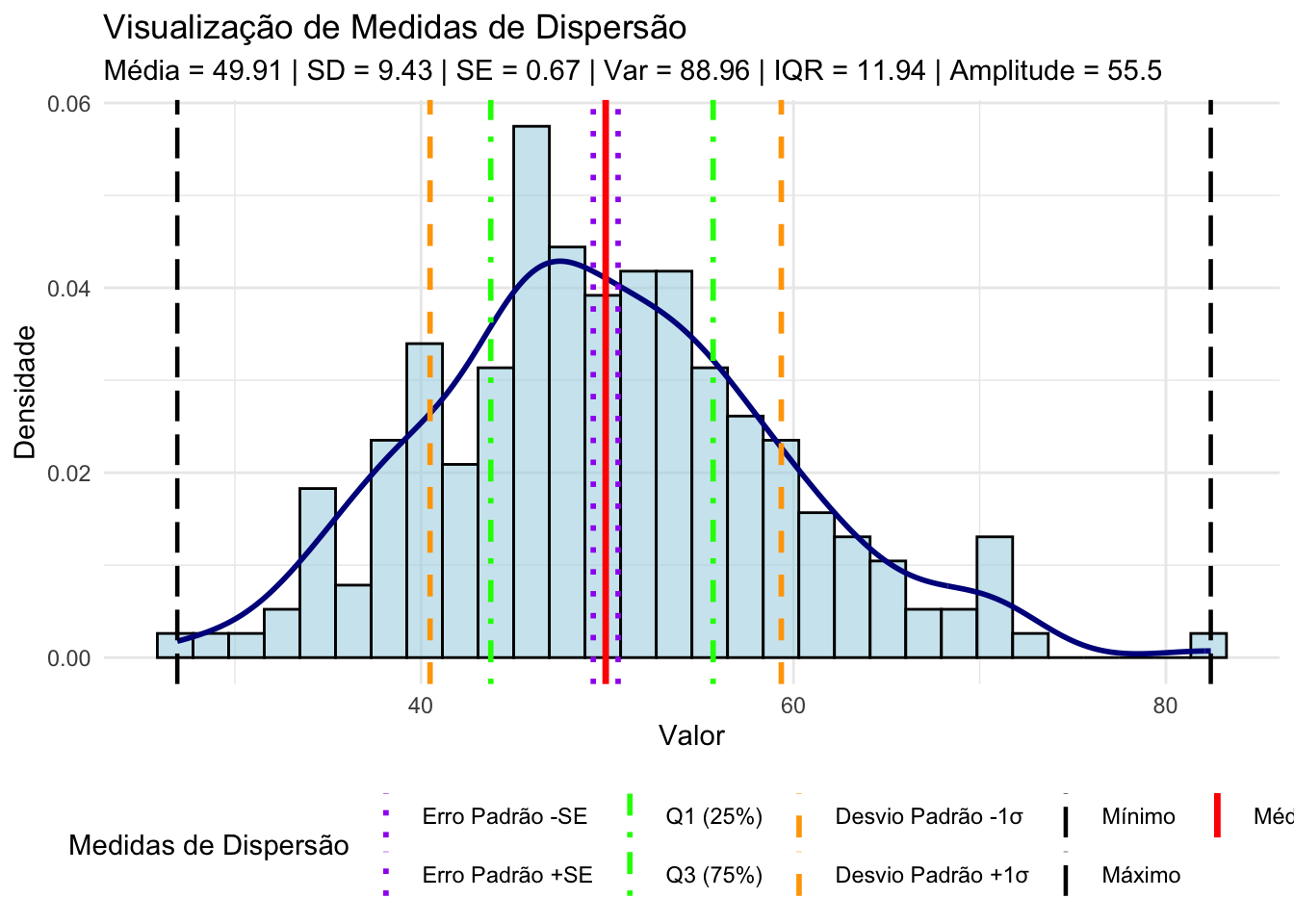

Figura 16.15: Parâmetros de dispersão em distribuições normais.

O pacote stats156 fornece a função confint para calcular o intervalo de confiança em um nível de significância \(\alpha\).

16.8.2 Como escolher o parâmetro de dispersão?

Desvio-padrão \(\sigma\) é apropriado quando a média é utilizada como parâmetro de tendência central em distribuições simétricas.207

Amplitude ou intervalo interquartil são apropriadas para variáveis ordinais ou distribuições assimétricas.207

16.8.3 O que é a correção de Bessel para variância?

Correção de Bessel é um ajuste feito no denominador da fórmula de variância da amostra — ou seja, o número de graus de liberdade — para evitar que a variância amostral seja menor do que a variância populacional.208

A correção de Bessel é feita subtraindo-se 1 do número de observações da amostra, ou seja, \(n - 1\) (16.12).208

\[\begin{equation} \tag{16.12} s^2 = \frac{\sum_{i=1}^{n} (x_i - \bar{x})^2}{n-1} \end{equation}\]

16.8.4 Por que a correção de Bessel para variância é importante?

A correção de Bessel é importante porque a variância amostral tende a ser menor do que a variância populacional, especialmente em amostras pequenas.208

A correção de Bessel ajuda a garantir que a variância amostral seja uma estimativa mais precisa da variância populacional, o que é fundamental para a validade dos testes estatísticos e das inferências feitas a partir da amostra.208

16.9 Proporção

16.9.1 Que parâmetros de proporção podem ser estimados?

\[\begin{equation} \tag{16.13} f_i = n_i \end{equation}\]

\[\begin{equation} \tag{16.14} fr_i = \frac{n_i}{N} \end{equation}\]

- Percentil (16.15), onde \(k\) é o percentil desejado (0 a 100) e \(n\) é o número total de observações na amostra.134,201,203

\[\begin{equation} \tag{16.15} P_k = x_{\left(\frac{k}{100} \cdot (n+1)\right)} \end{equation}\]

Quantil: é o ponto de corte que define a divisão da amostra em grupos de tamanhos iguais. Portanto, não se referem aos grupos em si, mas aos valores que os dividem:203

Tercil: 2 valores que dividem a amostra em 3 grupos de tamanhos iguais.203

Quartil: 3 valores que dividem a amostra em 4 grupos de tamanhos iguais.203

Quintil: 4 valores que dividem a amostra em 5 grupos de tamanhos iguais.203

Decil: 9 valores que dividem a amostra em 10 grupos de tamanhos iguais.203

16.10 Extremos

16.11 Erro

16.11.1 Que parâmetros de erro podem ser estimados?

- Margem de erro (ME).(16.18).

\[\begin{equation} \tag{16.18} ME = z_{\alpha/2} \cdot \frac{\sigma}{\sqrt{n}} \end{equation}\]

\[\begin{equation} \tag{16.19} EPM = \frac{\sigma}{\sqrt{n}} \end{equation}\]

\[\begin{equation} \tag{16.20} \widehat{EPM} = \frac{s}{\sqrt{n}} \end{equation}\]

16.12 Distribuição

16.12.1 Que parâmetros de distribuição podem ser estimados?

\[\begin{equation} \tag{16.21} \gamma_1 = \frac{\frac{1}{n}\sum_{i=1}^{n}(x_i - \bar{x})^3}{\left(\frac{1}{n}\sum_{i=1}^{n}(x_i - \bar{x})^2\right)^{3/2}} \end{equation}\]

\[\begin{equation} \tag{16.22} \gamma_2 = \frac{\frac{1}{n}\sum_{i=1}^{n}(x_i - \bar{x})^4}{\left(\frac{1}{n}\sum_{i=1}^{n}(x_i - \bar{x})^2\right)^{2}} \end{equation}\]

\[\begin{equation} \tag{16.23} \kappa = \gamma_2 - 3 \end{equation}\]

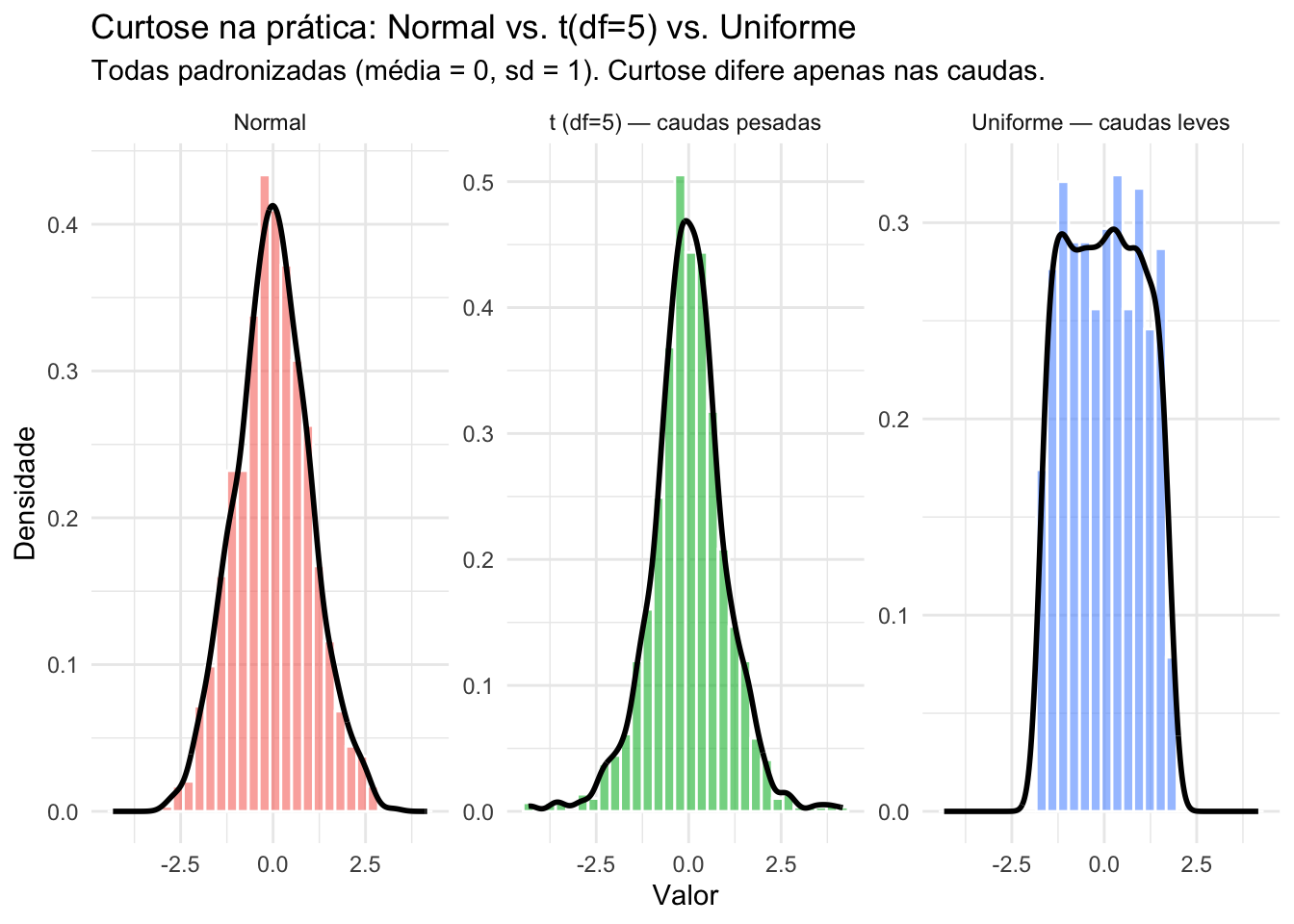

Figura 16.17: Parâmetros de distribuição: Assimetria e Curtose.

Figura 16.18: Parâmetros de distribuição: Curtose em distribuições simétricas (normal vs. uniforme).

16.13 Parâmetros robustos

16.13.1 O que são parâmetros robustos?

- Parâmetros robustos são medidas de posição e dispersão que permanecem estáveis mesmo na presença de valores discrepantes.209

16.13.2 Por que utilizar parâmetros robustos?

Parâmetros robustos garantem maior confiabilidade quando os dados não seguem a normalidade ou apresentam contaminação por outliers.209

Parâmetros robustos permitem análises mais estáveis em estudos exploratórios, evitando decisões equivocadas sobre variabilidade ou tendência central.209

16.13.3 O que é ponto de quebra?

- É a menor proporção de contaminação que pode levar o estimador a resultados arbitrariamente errados; quanto maior, mais robusto.210

16.13.4 Que parâmetros robustos podem ser estimados?

Média e variância Winsorizadas como opções intermediárias, reduzindo a influência dos outliers.209

Mediana, com \(~50%\) de ponto de quebra e função influência limitada.209,210

Median Absolute Deviation (MAD) (16.24), com correção 1,483 para normalidade, com \(~50%\) de ponto de quebra.209,210

\[\begin{equation} \tag{16.24} MAD = 1.483 \cdot \text{median}(|x_i - \text{median}(x)|) \end{equation}\]

\[\begin{equation} \tag{16.25} Qn = 2.2219 \cdot \text{first quartile}(|x_i - x_j|; i < j) \end{equation}\]

- O intervalo interquartil (\(IQR\)) (16.11) é robusto, com ponto de quebra \(~25%\), sendo simples de interpretar e útil em boxplots.210

Ferreira, Arthur de Sá. Ciência com R: Perguntas e respostas para pesquisadores e analistas de dados. Rio de Janeiro: 1a edição,